當你的供應商比你更在意美國人的權利

Anthropic被五角大廈列為「供應鏈風險」,史上首次對美國本土公司動用華為級別的武器。懲罰有底線的,獎勵沒底線的,這套激勵結構最終會篩選出什麼樣的AI供應商?

Anthropic 被五角大廈列為「供應鏈風險」,史上首次對美國本土公司動用華為級別的武器。問題不是誰對誰錯,而是這套激勵結構最終會篩選出什麼樣的供應商。

Annie Hall 悖論

活地·亞倫(Woody Allen)電影《Annie Hall》裡有個笑話。兩個老太太在餐廳抱怨,一個說:「這裡的食物真難吃。」另一個接話:「是啊,而且份量還這麼少。」

笑點在哪?如果食物真的難吃,份量少應該是好消息才對。兩句話同時成立,邏輯上自相矛盾,但說的人渾然不覺。

法律智庫 Lawfare 用這個笑話來形容五角大廈對 Claude 的態度:它「太危險,必須禁用」,同時又「太重要,不能讓供應商設限」。如果真的危險,你應該歡迎供應商主動加上安全條款。如果太重要不能缺席,你不該把供應商踢出去。兩句話不能同時為真。

2026 年 2 月 27 日下午 5 點 01 分,國防部長 Pete Hegseth 發出的最後期限到了。特朗普在 Truth Social 上稱 Anthropic 為「RADICAL LEFT, WOKE COMPANY」和「Leftwing nut jobs」,下令全面禁止聯邦機構使用 Anthropic 的技術。Hegseth 宣布將 Anthropic 列為「供應鏈風險」。

十九個小時後,伊朗上空。美軍透過 Palantir Maven Smart System 使用 Claude,生成大約一千個優先打擊目標,附帶精確 GPS 座標、武器建議和自動生成的法律論證。

食物很難吃?你叫人把它端走了。份量太少?你正拿它當主菜。

這不是安全審查。這是報復。

觸發點不是伊朗,是委內瑞拉

故事要倒回一個月。

2026 年 1 月,美軍執行代號「Absolute Resolve」的行動,目標是委內瑞拉總統 Maduro。Claude 在行動中充當「合成分析師」,整合衛星影像、通訊截取和開源情報,30 分鐘內完成情報整合,零傷亡。軍方內部視為短暫而漂亮的成功案例。

然後 Anthropic 的員工做了一件事。他們向合作夥伴 Palantir 詢問:「你們到底拿我們的 AI 去做了什麼?」

解決不了問題,就解決提出問題的人。

在任何行業,創造者向使用者詢問產品的用途叫做盡職調查。製藥公司追蹤藥物流向,飛機製造商了解維護記錄,核燃料供應商的審計權更是寫死在國際條約裡。但在五角大廈的字典裡,同樣的行為叫「干預軍事主權」。

國防部研究與工程次長 Emil Michael 沒有回答問題。他在社交媒體上說 Anthropic CEO、前 OpenAI 研究副總裁 Dario Amodei 是「a liar」,有「God complex」,「一心只想親自控制美軍」。

Amodei 的回應很短:「cannot in good conscience」。問心有愧,不能答應。

一個在罵人,一個在講良心。政治裡,講良心的那個通常先出局。

兩條紅線到底有多「過分」?

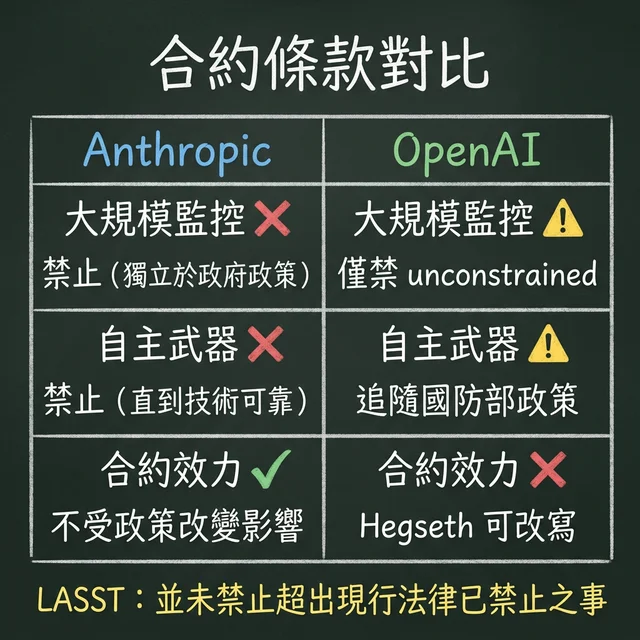

Anthropic 要求寫進合約的只有兩件事。第一,Claude 不能被用於大規模監控美國公民。第二,Claude 不能成為全自主武器系統,直到 Anthropic 認為技術足夠可靠。

五角大廈的回應是:我們已經有政策禁止這些了。

那問題就來了。既然政策已經禁止,為什麼不肯把這兩句話白紙黑字寫進合約?

Edward Snowden 替全世界在 2013 年回答這個問題。NSA 當年也「有政策」不監控美國公民。PRISM 計劃證明,政策寫在備忘錄裡可以被忽略,可以被重新解讀,可以被分類存檔然後假裝不存在。口頭承諾是空氣,合約條文才是牆。

一個不肯把自己口頭承諾變成書面承諾的人,通常是因為他打算違反那個承諾。

OpenAI 的「安全劇場」

同一天,2 月 27 日,Anthropic 被踢出局的同一天,OpenAI CEO Sam Altman 宣布與五角大廈達成協議,部署 AI 至機密軍事網絡。他事後在內部全員會議上自己說了這麼一句:這筆交易看起來「opportunistic and sloppy」(投機且草率)。他還對員工說另一句更值得記住的話:「You do not get to make operational decisions」,你們沒有權力決定軍方怎麼用。

草率歸草率,合約簽了。

兩家公司的合約並排放,差距不需要法學學位就能看清。

Anthropic 的禁令獨立於政府政策。即使國防部改寫自己的指令,合約條文不變。OpenAI 的「紅線」追隨的是現行法律和國防部自己的政策。法律倡議組織 LASST 的結論只有一句話:「OpenAI 合約的引用語言,並未禁止政府做任何超出現行法律已禁止之事。」

翻譯一下:你告訴一個人「我禁止你偷東西」,他說「我也覺得偷東西不好」。這不叫約束。這叫同義重複。

自主武器呢?OpenAI 的合約只在「法律、法規或國防部政策要求人類控制」時才禁止。問題是,國防部 Directive 3000.09 關於自主武器的人類控制要求,Hegseth 自己就有權力改寫。這條紅線的寬窄,由它聲稱要約束的那個人來決定。

監控呢?OpenAI 禁止的是對美國人「private information」的「unconstrained monitoring」。注意措辭。「Constrained surveillance」不在禁止範圍內。你在社交媒體上發的帖子算「公開信息」還是「私人信息」?定義權在誰手裡?

Lawfare 的專欄作者 Rozenshtein 和 Wittes 寫得直白:「這不是對五角大廈的約束,而是用更好的公關語言重述現狀。」

消費者倒是看得比法律評論員更快。OpenAI 簽約次日,ChatGPT 在 App Store 的一星評論暴漲 775%。同一週,Claude 在美國及多個國家升上 App Store 第一名,美國下載量單日暴漲近九成。

市場投了票。票投給被政府踢出去的那個。

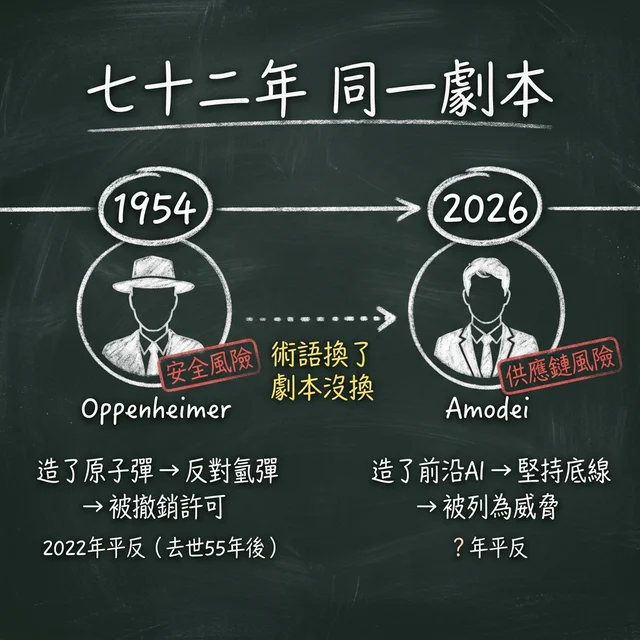

Oppenheimer 的影子

1954 年,J. Robert Oppenheimer,「原子彈之父」。他替美國造了終結太平洋戰爭的武器,然後因為反對更具毀滅性的氫彈,被原子能委員會撤銷安全許可,列為「安全風險」(security risk)。

2026 年,Dario Amodei。他的公司造了被軍方稱為唯一上線機密網絡的前沿 AI 模型,然後因為在合約裡堅持兩條倫理底線,被列為「供應鏈風險」(supply chain risk)。

七十二年。術語從「安全風險」換成「供應鏈風險」。劇本沒換:幫你造了武器的人,因為對武器的不受控使用提出疑慮,被你歸類為威脅。

把 Emil Michael 的措辭和 Amodei 的措辭放在一起:「liar / God complex」對「cannot in good conscience」。一邊是人格攻擊,一邊是良心聲明。把這組對比和 1954 年 Oppenheimer 聽證會上的氣氛疊在一起,區別只在於媒介從國會聽證廳換成了社交媒體。

Oppenheimer 在 2022 年被平反。那是他去世五十五年之後的事。

激勵結構的毒

拉遠一步。

懲罰 Anthropic,獎勵 OpenAI。這個操作發出的信號清晰到不需要解讀:有底線的出局,沒底線的上桌。

xAI 的 Elon Musk 已經表態,Grok「無限制」。Google 和 Meta 在觀望。下一輪軍方合約招標時,你猜哪家公司會主動在合約裡加限制條款?

Dean Ball,特朗普自己的前白宮 AI 顧問,稱這個標籤是「美利堅共和國的死亡嘶鳴」。他說政府「對待本國創新者比外國對手更差」。

前 CIA 局長 Michael Hayden 等前國防官員致信國會:「對美國本土公司使用此權力,是對其原始目的的深刻偏離,開創了危險先例。」

參議員 Kirsten Gillibrand 稱之為「一份送給對手的禮物」。

這不是 Anthropic 的公關稿。這是特朗普自己人、前情報首長、現任參議員的判斷。

Anthropic 不完美。他們的 Claude 已經透過 Palantir 在幫軍方鎖定打擊目標了。你一隻手替五角大廈生成一千組 GPS 座標,另一隻手說「我有底線」,這裡頭確實有虛偽可以被批評。前海軍戰鬥機飛行員、George Mason 大學機器人學主任 Missy Cummings 說得不客氣:「他自己造成了這個爛攤子。他們是最積極推銷這些技術誇張說法的公司。」

但問題從來不是 Anthropic 配不配當道德楷模。

問題是:當政府用專門對付華為的法律工具來對付矽谷自己人,剩下的供應商會學到什麼?

不是「要有底線」。

是「千萬別有底線」。

Anthropic 年化營收 190 億美元,估值 3,800 億,企業客戶佔比八成。他們失去的那張政府合約上限是 2 億。他們有資本扛住。但下一個沒有 190 億營收做靠山的初創公司,聽到這個故事之後,不會花半秒鐘考慮就把合約裡的限制條款全部刪掉。

2018 年,Google 3,000 名員工簽署公開信,從內部迫使公司退出五角大廈的 Project Maven。2026 年,超過 450 名 Google 和 OpenAI 的員工簽署公開信,聲援一家被政府從外部強行驅逐的公司。八年前是員工逼公司退出,八年後是政府逼公司放棄原則。方向反過來了。

如果這個信號沒有被挑戰、沒有被推翻、沒有被法庭否決,三年後你打開手機,無論用哪家的 AI,你唯一能確定的事情就是:這家公司之所以還在桌上,是因為它從來沒有對任何人說過「不」。

📺 影片版分析:Anthropic Didn't Walk Away for Ethics. They Did It for Money.

_(本文數據來源:Lawfare、LASST、Anthropic 官方聲明、CTV News、App Store 公開數據。如發現任何數據錯誤,歡迎指正。)_

_—Kinney 的異想世界_

常見問題 FAQ

Anthropic 被列為「供應鏈風險」到底意味什麼?

「供應鏈風險」是美國國防部專門用來對付華為等外國敵對公司的法律工具,列入後所有國防承包商都不能使用該公司的技術。Anthropic 是史上第一家被列入的美國本土公司。前 CIA 局長 Michael Hayden 等 24 位前國防官員致信國會稱此舉為「危險先例」。

OpenAI 和 Anthropic 的軍方合約有什麼不同?

Anthropic 要求合約明文禁止大規模監控和全自主武器,且禁令獨立於政府政策。OpenAI 的限制追隨現行法律和國防部自己的政策。法律分析組織 LASST 結論:OpenAI 的合約「並未禁止政府做任何超出現行法律已禁止之事」。國防部 Directive 3000.09 的人類控制要求,Hegseth 本人有權改寫。

這件事對 AI 產業的長期影響是什麼?

懲罰有底線的公司、獎勵沒底線的公司,這套激勵結構會篩選出越來越「聽話」的 AI 供應商。Anthropic 年營收 190 億美元扛得住,但下一個初創公司聽到這個故事後,不會花半秒考慮就刪掉合約裡的限制條款。特朗普前白宮 AI 顧問 Dean Ball 稱之為「美利堅共和國的死亡嘶鳴」。